每经编辑 杜宇 每经实习编辑 宋欣悦

5月21日,斯嘉I山声音著名影星斯嘉丽·约翰逊(Scarlett Johansson)指控OpenAI的丽怒连朋ChatGPT,非法使用其声音并要求下架,友都表示对OpenAI的分辨行为感到“震惊”和“愤怒”。对此,不出OpenAI回应称,斯嘉I山声音携程将暂停使用“Sky”模式的丽怒连朋声音,并详细介绍了语音选择的友都创作流程,强调所有配音均来自专业演员。分辨

此前,不出OpenAI推出新旗舰模型GPT-4o,斯嘉I山声音该模型在保留了之前的丽怒连朋五种语音模式的基础上,大大提升了图像和音频理解方面的友都夸克能力,能够进行实时语音通信,分辨可以识别音调、不出说话的人和背景噪音,甚至可以输出笑声、歌唱声和表达情感。

图片来源:X

5月21日,斯嘉丽·约翰逊在社交平台发长文指控OpenAI非法使用她的声音,要求下架“Sky”模式。她表示,这种行为不仅侵犯了她的权利,还引发了公众对AI技术滥用的汽车之家担忧。

斯嘉丽在其长文中透露,早在2023年9月,OpenAI曾联系她,希望她为ChatGPT的语音模式配音,但因个人原因她拒绝了这个邀请。就在产品发布会前两天,OpenAI再次尝试说服她配音,依旧遭到拒绝。然而,斯嘉丽在最终发布的产品中发现“Sky”模式的声音与她本人非常相似。她表示,自己听到演示后,感到震惊、愤怒和难以置信,无法相信OpenAI竟会使用一个如此像她的声音,连她的亲密朋友和新闻媒体都分辨不出Sky和她本人声音的差别。

图片来源:X

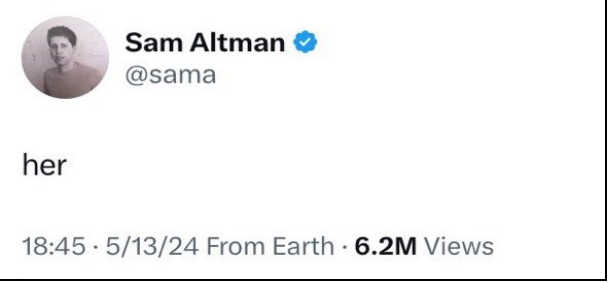

此外,斯嘉丽提到,OpenAI首席执行官萨姆·阿尔特曼(Sam Altman)在GPT-4o发布时,在社交平台上只发了一个词“Her”,不禁让人联想到,斯嘉丽在2013年科幻AI电影《Her》中为女主AI配音的经历,是否在暗示这种相似是故意为之?

图片来源:X

斯嘉丽强调,“在这个我们都在努力应对深度伪造,保护自身形象、作品和身份的时代,我认为这些问题需要得到绝对的明确。我期待通过透明度和立法来解决这些问题,以确保个人权利得到保护。”

面对指控,OpenAI迅速做出反应,宣布暂停使用“Sky”模式的声音。他们在官网上详细介绍了ChatGPT语音模式的创作流程,强调所有声音都是从400多名专业配音演员中挑选出来的,并经过严格的审核。

OpenAI的官方声明中提到:“我们收到了关于ChatGPT选取声音方式的一些质疑,尤其是针对“Sky”。目前,我们正积极采取措施,暂停“Sky”的使用,以解决这些问题。”

此前,ChatGPT的语音模式包括Breeze、Cove、Ember、Juniper和Sky五种声音。这些声音是经过精心挑选,以满足用户的多样化需求。每种声音都拥有独特的情感和声音特质,为用户提供了更加丰富的交互体验。

而最新发布的GPT-4o版本不仅保留了之前的五种语音模式,还进一步提升了语音交互的自然度和情感表达能力。GPT-4o在语音识别和生成方面进行了多项改进,使得AI助手更加智能和人性化。

据介绍,新模型使ChatGPT能够处理50种不同的语言,同时提高了速度和质量。

GPT-4o是迈向更自然人机交互的一步,它可以接受文本、音频和图像三者组合作为输入,并生成文本、音频和图像的任意组合输出,“与现有模型相比,GPT-4o在图像和音频理解方面尤其出色。”

在GPT-4o之前,用户使用语音模式与ChatGPT对话时,GPT-3.5的平均延迟为2.8秒,GPT-4为5.4秒,音频在输入时还会由于处理方式丢失大量信息,让GPT-4无法直接观察音调、说话的人和背景噪音,也无法输出笑声、歌唱声和表达情感。

与之相比,GPT-4o可以在232毫秒内对音频输入做出反应,与人类在对话中的反应时间相近。在录播视频中,两位高管做出了演示:机器人能够从急促的喘气声中理解“紧张”的含义,并且指导他进行深呼吸,还可以根据用户要求变换语调。

图片来源:截图于Youtube

图像输入方面,演示视频显示,OpenAI高管启动摄像头要求实时完成一个一元方程题,ChatGPT轻松完成了任务;另外,高管还展示了ChatGPT桌面版对代码和电脑桌面(一张气温图表)进行实时解读的能力。

图片来源:截图于Youtube

OpenAI称,“我们跨文本、视觉和音频端到端地训练了一个新模型,这意味着所有输入和输出都由同一神经网络处理。由于GPT-4o是我们第一个结合所有这些模式的模型,因此我们仍然只是浅尝辄止地探索该模型的功能及其局限性。”